Material del curso “Recursos metodológicos y estadísticos para la docencia e investigación” M MAATTEERRIIAALL VVII ““

Medición del Acuerdo entre Codificadores: Por qué el Kappa de Cohen no es una buena opción - ATLAS.ti | El software nº 1 para el análisis cualitativo de datos

Redalyc.CÁLCULO DE LA FIABILIDAD Y CONCORDANCIA ENTRE CODIFICADORES DE UN SISTEMA DE CATEGORÍAS PARA EL ESTUDIO DEL FORO ONLIN

Evaluación de la calidad de estudios de metaanálisis sobre la eficacia de las intervenciones en revistas españolas de psicología

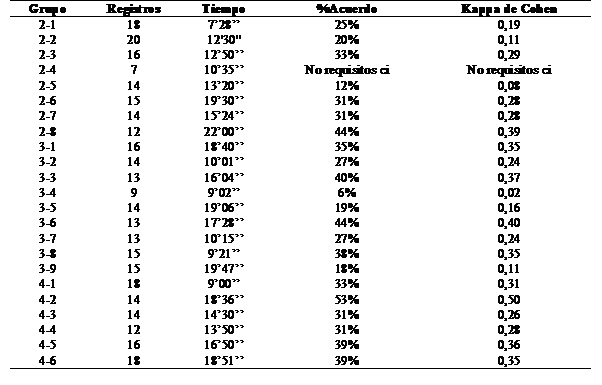

Concordancia consensuada en metodología observacional: efectos del tamaño del grupo en el tiempo y la calidad del registro

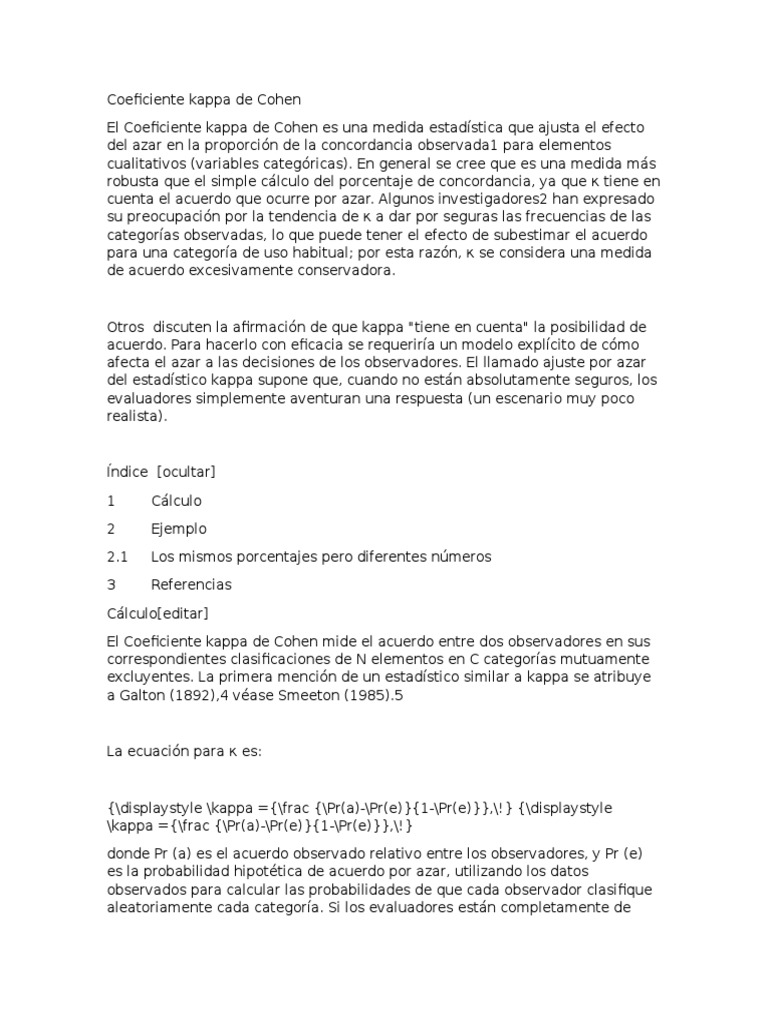

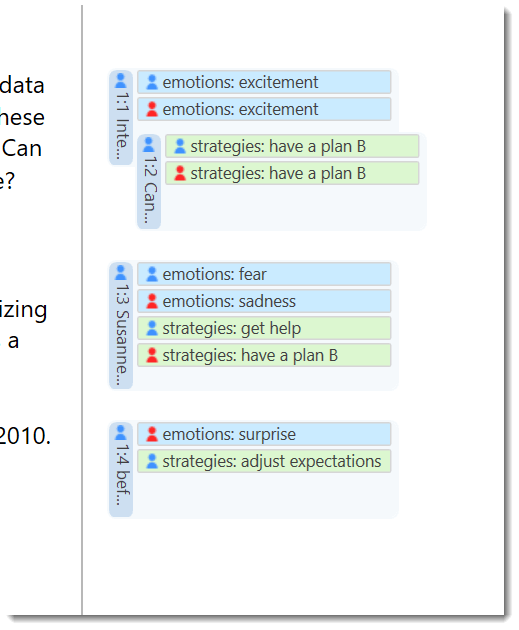

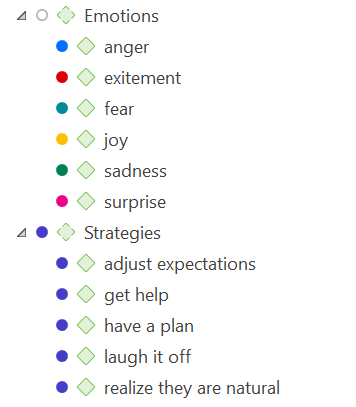

Medición del Acuerdo entre Codificadores: Por qué el Kappa de Cohen no es una buena opción - ATLAS.ti | El software nº 1 para el análisis cualitativo de datos

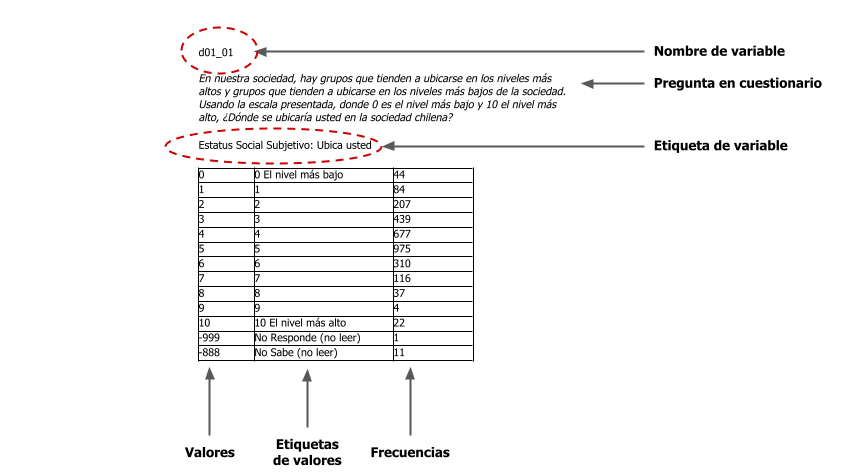

Redalyc.CÁLCULO DE LA FIABILIDAD Y CONCORDANCIA ENTRE CODIFICADORES DE UN SISTEMA DE CATEGORÍAS PARA EL ESTUDIO DEL FORO ONLIN

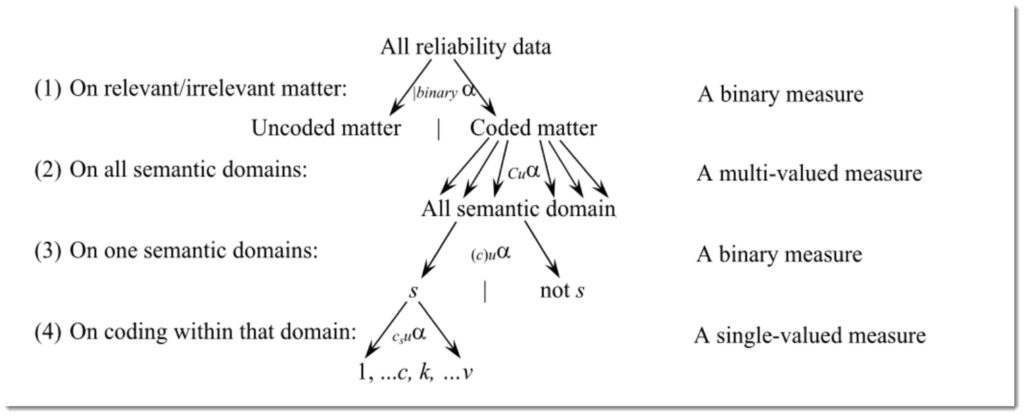

Medición del Acuerdo entre Codificadores: Por qué el Kappa de Cohen no es una buena opción - ATLAS.ti | El software nº 1 para el análisis cualitativo de datos

Redalyc.CÁLCULO DE LA FIABILIDAD Y CONCORDANCIA ENTRE CODIFICADORES DE UN SISTEMA DE CATEGORÍAS PARA EL ESTUDIO DEL FORO ONLIN

Redalyc.CÁLCULO DE LA FIABILIDAD Y CONCORDANCIA ENTRE CODIFICADORES DE UN SISTEMA DE CATEGORÍAS PARA EL ESTUDIO DEL FORO ONLIN

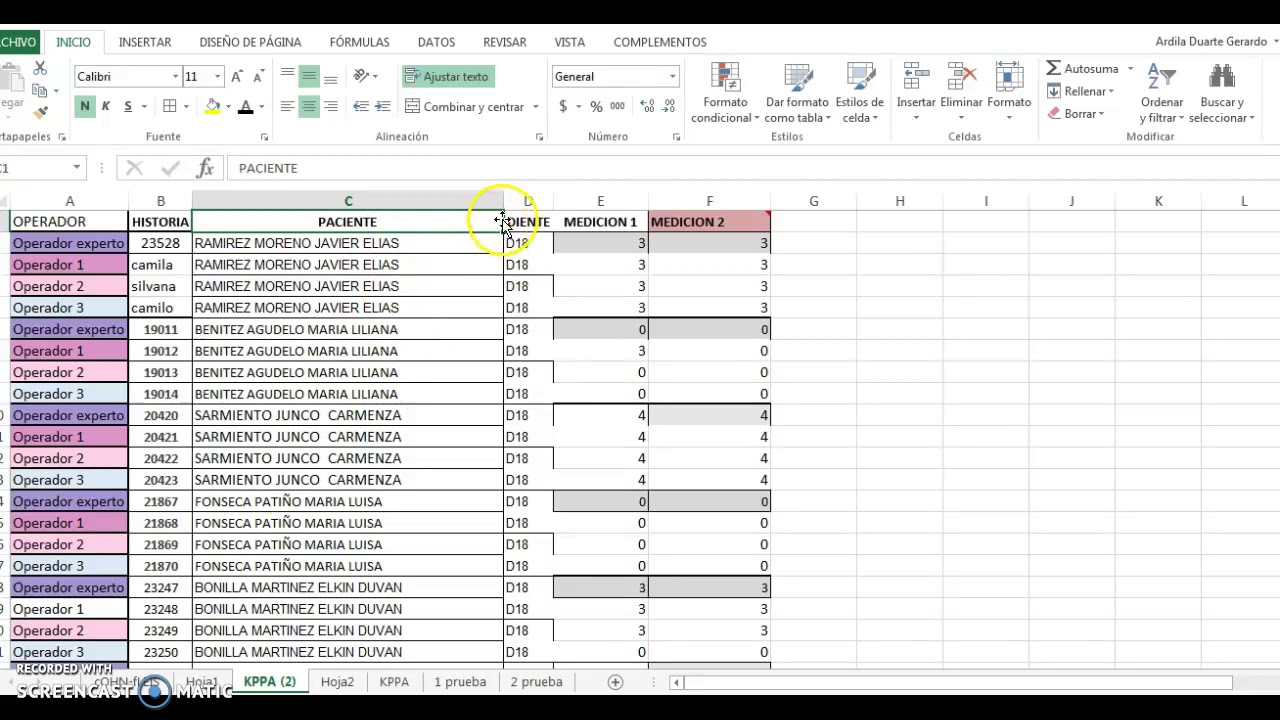

Concordancia consensuada en metodología observacional: efectos del tamaño del grupo en el tiempo y la calidad del registro

PDF) El Índice Kappa de Cohen como Herramienta para la Reducción de Ruido de Información Cerebral en la Identificación de Niveles de Valencia

Evaluación de la calidad de estudios de metaanálisis sobre la eficacia de las intervenciones en revistas españolas de psicología

Empleo del Análisis de Redes Sociales para el estudio de la estructura de la relación entre definiciones del concepto estrategia elaboradas entre los años 1962 y 2003